近日,国际人工智能领域顶级学术会议ICML 2026公布了录用论文。我校人工智能学部能源大数据智慧计算科研团队负责人杜海舟老师及其硕士生黄力鑫撰写的长文论文《FedEMoE: Improving Personalization on Heterogeneous Federated Learning via Elastic Mixture of Experts Architecture》被录用。这是学校首次在人工智能领域顶级国际学术会议ICML上发表分布式机器学习领域研究成果,标志着我校在分布式机器学习方向研究达到国际领先水平。

ICML(International Conference on Machine Learning)是人工智能领域最具影响力的顶级国际学术会议之一,为CCF推荐A类会议及CORE Conference Ranking A*级,其H-5指数254,Impact Score 32.4,在全球范围内享有极高学术声誉,是学术界和工业界公认的重要交流平台。自1980年于美国匹兹堡创办以来已连续举办40余届,被公认为学术界与工业界的重要交流平台与机器学习研究的旗舰会议。近年来,ICML的投稿数量和竞争激烈程度屡创新高,但录用率长期维持在20%-25%左右,2026年投稿量更是突破23,000篇。本次会议将于2026年7月6日至7月11日在首尔举行。

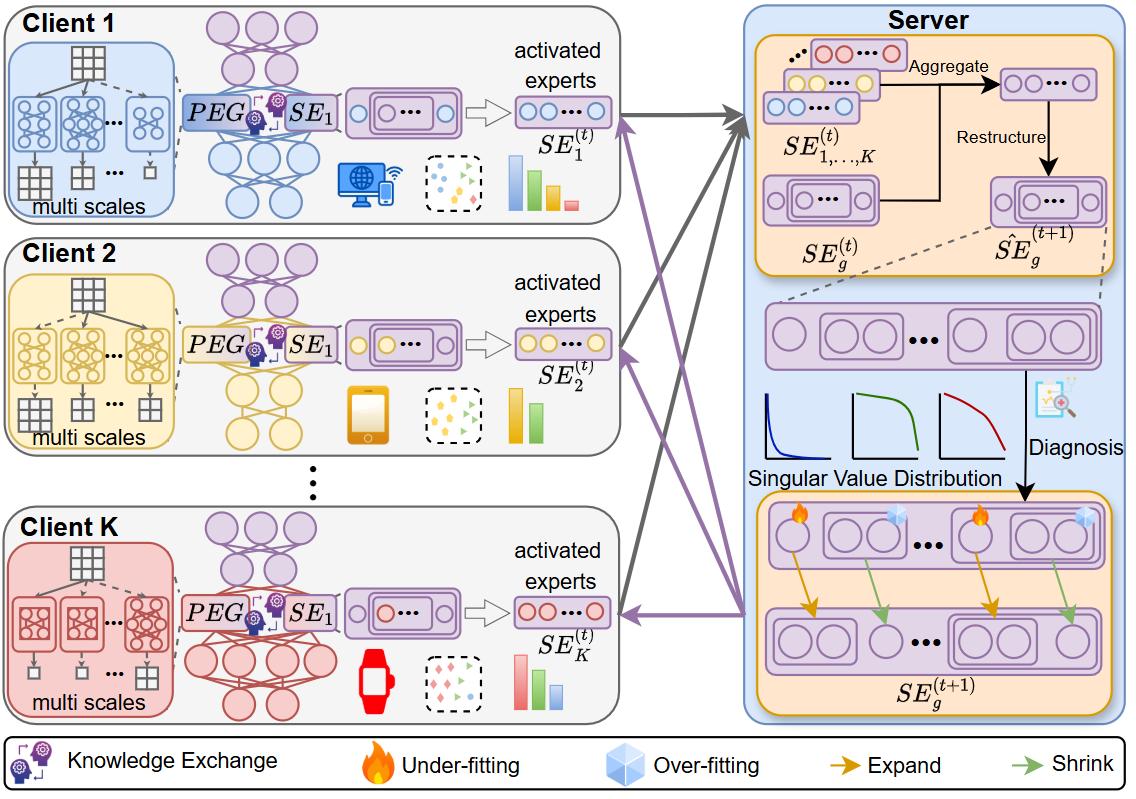

该论文聚焦分布式异构机器学习中由客户端模型架构与数据分布差异引发的双重异构挑战,特别关注个性化需求与全局共识冲突所导致的知識迁移瓶颈。现有方法多强制共享统一模型结构或依赖公共数据集进行知识蒸馏,难以兼顾隐私保护与个性化表达。为此,本文提出FedEMoE,一个基于弹性混合专家(Elastic Mixture of Experts, EMoE)的联邦学习新框架。该框架为每个客户端设计多尺度特征提取与知识交换机制,并首次在服务端引入基于权重谱分析的EMoE架构:利用奇异值分解动态评估专家状态(欠拟合/过拟合),智能执行扩展与收缩操作,从而协同解决模型异构下的个性化知识保留与泛化知识融合难题。实验结果表明,在多个高异构图像分类数据集上,FedEMoE的任务准确率相比现有最先进异构联邦学习方法最高提升48.05%,同时通信开销显著降低。

图1 FedEMoE框架整体概览

该研究成果在大模型时代构建新一代分布式智能系统方面具有广泛应用前景。在大小模型协同与分布式数据分析应用中,FedEMoE能够扩展大小模型协同的Scaling law,兼顾性能与隐私保护。在能源电力行业,FedEMoE支持对分布在不同区域电网的设备故障数据进行联合建模,在不泄露隐私的前提下实现故障模式的精准预测与诊断。长远来看,该框架为个性化与泛化能力的深度协同提供了关键路径,为构建更智能、更可信的边缘人工智能系统奠定了坚实基础。

能源大数据智慧计算团队长期聚焦人工智能核心领域,在分布式机器学习、多模态大模型推理、自然语言处理及知识图谱等方向上持续深耕,已产出一系列高水平研究成果。近年来,团队多篇论文获NeurIPS、ICML、AAAI、WWW、ECAI、ECML、CIKM、IWQoS等国际顶级会议录用,展现出稳步迈向国际科研前沿的坚实能力。此次论文入选机器学习顶级会议ICML,既是对团队长期科研积累的高度认可,也为我校分布式机器学习方向的发展注入新动能。未来,团队将持续围绕学术前沿,致力于产出兼具顶尖水平与现实价值的研究成果。

人工智能学部 供稿